# 简要介绍

以目标识别任务为例,假设有一个已经训练好的模型 A,其任务是识别(猫,狗,人,鸡,鸭,鹅)这 6+1(背景)个类别的目标,当我们的需求发生变化,需要再增加一类目标 “猪” 时,如果采用重新训练一个新模型 B 的方式无疑会增加成本,而且造成了资源浪费 ——A 和 B 的模型需求相似度高,我们为什么不可以利用到已经成熟的模型 A 呢?

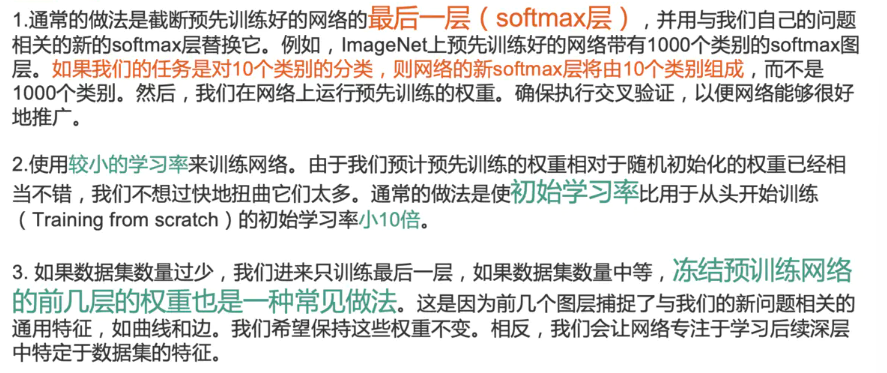

解决以上问题的方案就是 fine-tune,微调!比如针对于以上举例,可以采用的一个微调策略是保留模型 A 的前若干层的结构以及它们训练后的权重,然后更改模型最后一层的 softmax,调整其映射到(猫,狗,人,鸡,鸭,鹅,猪)+ 背景这八个类别,这样就大大减少了训练的时间和计算成本。

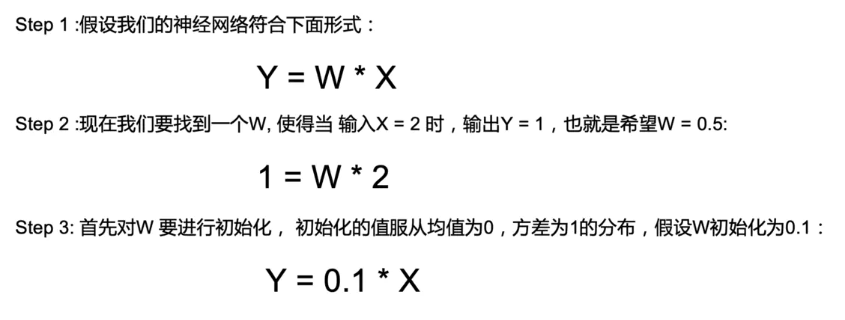

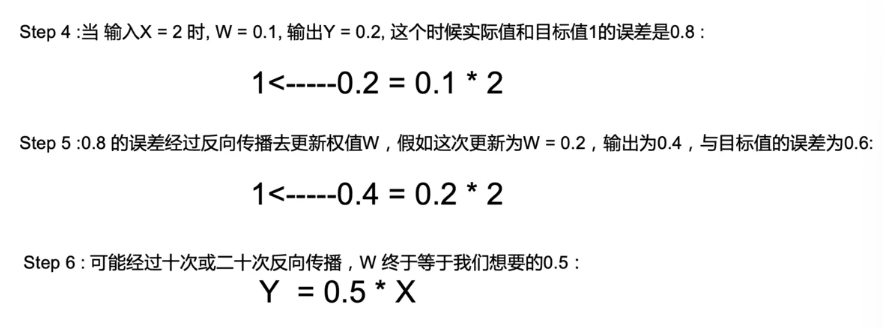

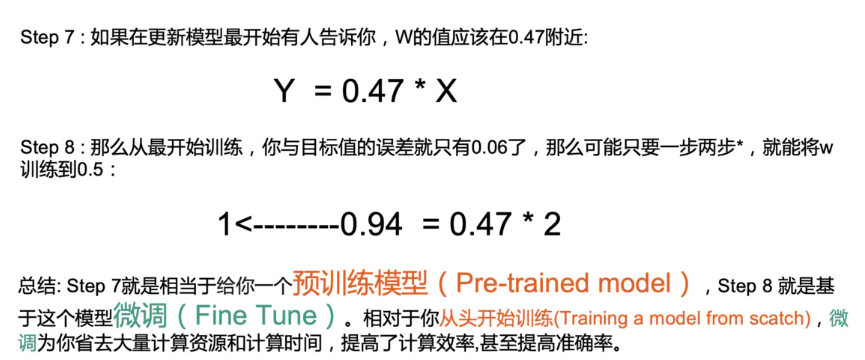

其实还可以这么理解 fine-tune:我们的目标是使预测损失最小化,在各个参数展开的空间内找到最优的点(或者是靠近最优点的点),如果从开始找,当然比较慢;但是从之前已经训练好的其他类似模型开始,就相当于在最优点附近的点开始,自然收敛的速度和效果会比从零训练好得多。

# 为什么要微调

# 什么情况下使用微调

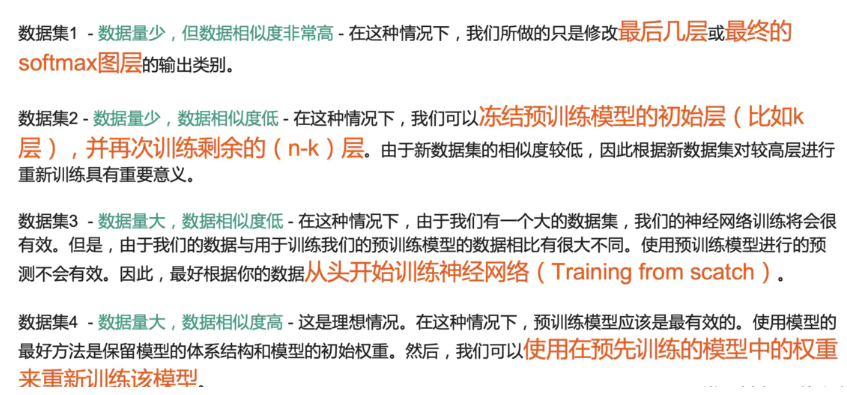

# 不同数据集上使用微调

# 微调指导事项